Sciences comportementales et sensibilisation cybersécurité : pourquoi et comment

- Timoléon

- 18 déc. 2025

- 8 min de lecture

Dernière mise à jour : 20 févr.

Article rédigé en collaboration avec Etienne BRESSOUD, directeur France de IPSOS BVA Nudge et publié également dans le Guide de l’Économie Comportementale 2025

La boite à outils de sensibilisations des utilisateurs au risque cyber est fournie, mais pour quel usage ? Des affiches avec de l’humour (ou pas), les modules de e-learning un peu trop longs, les rappels « ne cliquez pas sur les liens suspects » que plus personne ne lit. Les erreurs humaines restent très fortement impliquées dans les incidents de cyber sécurité.

Et si les RSSI (Responsable de la Sécurité des Systèmes d'Information), principaux utilisateurs de cette boite à outils, changeaient de lunettes ? Qu’ils enlevaient les leurs, remplies de politiques, de risques et d’indicateurs, pour mettre celles des utilisateurs. Celui qui, comme nous tous, prend ses décisions au quotidien, non pas en analysant froidement chaque situation, mais souvent de manière automatique, rapide… et influencée par les biais cognitifs, qui le guident parfois pour le meilleur et parfois pour le pire !

Et si les utilisateurs étaient eux-mêmes conscients qu’ils ne suivront pas les règles de cyber sécurité, pas parce qu’ils ne le veulent pas, mais juste parce qu’ils ont du mal à passer de l’intention à l’action.

Alors les sciences comportementales nous éclaireraient sur les axes d’amélioration possibles, en plaçant l’humain au cœur des programmes de sensibilisation, et le nudge accompagnerait les changements de comportement des utilisateurs, pour leur faire adopter des comportements sans risque cyber.

Les apports du nudge à la cybersécurité

Le mot nudge vient de l’anglais, et signifie « coup de pouce ». Un coup de pouce bienveillant, qui incite doucement à adopter un comportement — sans jamais forcer. Ce concept, popularisé par Richard Thaler (Prix Nobel d’économie en 2017) et Cass Sunstein, repose sur une idée simple : notre environnement influence nos décisions (Thaler et Sunstein, 2008).

Par exemple, quand on équipe les ceintures de sécurité d’un car scolaire avec un fourreau jaune qui empêche la ceinture de disparaître dans l’enrouleur, et la maintient sur le siège, le taux de port de la ceinture par les enfants est multiplié par 2,4 (Bressoud et al., 2018). Pour deux raisons. La saillance, la couleur du fourreau (jaune) permet de voir la ceinture qui est le plus souvent noir sur un siège bleu marine. Et parce que pour s’assoir sur le siège, l’enfant doit toucher la ceinture. Pour l’écarter ou pour la mettre, puisqu’il ne s’agit pas de le forcer, et que s’il la touche, par défaut, la probabilité qu’il la mette augmente.

Les nudges sont une manière de présenter les choix pour favoriser un comportement souhaitable, en intégrant la réalité du processus de décision des êtres humains, sociaux et émotionnels que nous 98 sommes. Et cela ne coûte presque rien ! La compréhension de ce processus de décision, dont découle la conception des nudges, s’appuie sur les connaissances apportées par les sciences comportementales.

Et si le nudge s’applique à la sécurité des enfants, nul doute qu’il peut aussi s’appliquer à la sécurité des systèmes d'information.

Ce que nous apprennent les sciences comportementales

Pour sensibiliser efficacement à la cyber sécurité, c’est-à-dire pour changer les comportements à risque des utilisateurs, il faut comprendre comment ils décident, et décident de ne pas décider.

Une rationalité… très limitée

Herbert Simon, autre prix Nobel en 1978, l’avait bien compris : notre rationalité est limitée (Simon, 1972). Nous prenons des décisions avec peu d’information, peu de temps, et beaucoup d’émotions.

Demandez à un collègue s’il pense être meilleur que la moyenne pour détecter un mail frauduleux. Sans avoir l’information pour y répondre, il vous répondra rapidement, avec une haute opinion de lui-même. Il vous dira probablement oui. Comme plus de 90% des gens à qui nous posons cette question lors de conférences. Statistiquement, cela ne tient pas. Comme beaucoup d’entre nous, votre collègue est influencé par le biais de sur-confiance.

Autre biais fréquent : l’aversion à la perte (Tversky et Kahneman, 1974). La tristesse associée à une perte est environ deux fois plus forte que la joie procurée par un gain équivalent. D’après ce biais, si vous vous faites pirater les données personnelles et confidentielles de 100 personnes (collaborateurs de l’entreprise, clients, patients, …), vous serez probablement beaucoup plus embêtés que vous avez été satisfait lorsque vous avez réussi à collecter ces données… Ainsi, une communication qui dit que « En appliquant ces conseils, vous évitez une fuite de données » sera probablement plus efficace qu’une communication qui dit : « Apprenez à améliorer votre hygiène numérique ».

Plus de 200 biais cognitifs ont été mis au jours par les chercheurs en Sciences Comportementales (Benson, 2016).

200 biais qu’Ipsos BVA Nudge a résumé en 20 facteurs de changement. Un acronyme, une lettre pour un biais (cf. figure ci-dessous).

Deux systèmes de pensée

Selon Daniel Kahneman (2011) le fonctionnement de notre cerveau s’appuie sur deux systèmes qui ont chacun leur particularité. Le système 1, rapide, instinctif, émotionnel, qui fonctionne sans effort. Il prend les décisions en empruntant ce qui est appelé des raccourcis mentaux. Sur une route de montagne en lacet, il prend les raccourcis entre les virages, plus abrupts et plus rapides. Il est sollicité pour des décisions simples, telles que le résultat de l’opération 2+2. Le système 2, lent, réfléchi, logique, fonctionne avec effort. Sur la route de montagne sinueuse, il emprunte prudemment le virage en courbe et ne coupe pas entre les lacets. C’est celui qui est utilisé pour trouver la solution de l’opération 25x37. Selon les besoins, les décisions prises font appel aux systèmes 1 et / ou au système 2. Et le système 1 est celui que nous utilisons le plus souvent (Kahneman, 2011) !

Et heureusement, car nous prenons environ 35 000 décisions par jour. Ce dont nous serions incapables sans un système 1 efficace… mais parfois sujet aux erreurs : c’est bien lui qui est à la manœuvre quand un collaborateur clique machinalement sur un lien malveillant.

Sensibiliser, c’est souvent parler au système 2 (en expliquant, en argumentant), alors que dans le quotidien il faudrait d’abord capter le système 1.

Un petit exemple cyber : pourquoi les gens ne verrouillent-ils pas leur poste de travail ? Il y a pour cela plusieurs raisons. C’est contraignant de ressaisir son mot de passe, les utilisateurs n’y pensent pas, n’en voient pas l’intérêt, trouvent que c’est long à faire.

Quelques observations montrent également que les utilisateurs ne connaissent pas le raccourci Windows+L ou (Control + Commande + Q pour les Mac), qui simplifie le geste.

Le premier réflexe est de communiquer sur ce raccourci, et proposer aux gens de mettre un autocollant sur leur ordinateur, qui rappelle ce raccourci et le risque de ne pas verrouiller son clavier quand on quitte son poste de travail. C’est utile pour faire connaitre le raccourci, mais est-ce que cela incitera les gens à l’utiliser à chaque fois ? Alors pourquoi ne pas leur mettre en évidence avec tout simplement 2 petits autocollants qui mettent en saillance les touches Windows et L sur le clavier ? Qui apprend le raccourci et surtout rappelle de l’utiliser au bon moment.

C’est ce que propose le nudge, en anticipant les réactions, et en créant des dispositifs de sensibilisation qui en tiennent compte.

Quelques autres exemples concrets :

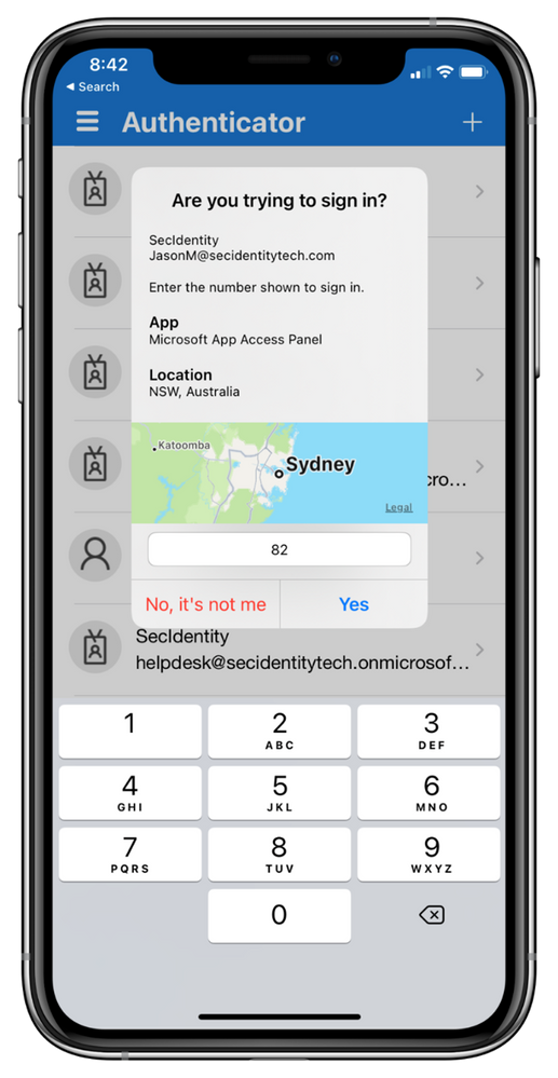

• Un rappel visuel contextuel, juste avant une action à risque comme par exemple la géolocalisation d’une demande de connexion, ou l’arnaque au faux conseiller. En posant la question « êtes-vous au téléphone avec l’un de nos conseillers ? », BoursoBank permet au client de s’extraire d’une ingénierie sociale téléphonique via un faux conseiller bancaire, puisque s’il répond oui, l’accès pour effectuer le virement lui est refusé.

• Un choix par défaut plus sécurisé, comme activer l’authentification à deux facteurs automatiquement, plutôt que de proposer de l’activer

• Un feedback immédiat, comme une jauge qui indique la robustesse d’un mot de passe au moment où il est saisi.

Quelques nudges visuels contextuels

Quelques nudges visuels contextuels

Et donc… comment sensibiliser autrement à la cybersécurité ?

Il y a deux façons d’intégrer le nudge et l’approche comportementale dans la sensibilisation. La première concerne les nudges que le RSSI peut implémenter lui-même, en intégrant la réalité des décisions de ses utilisateurs. La seconde concerne les nudges que les utilisateurs peuvent mettre en place pour eux mêmes, dès lors qu’ils prennent conscience de leurs faiblesses en matière de gestes cyber.

Intégrer la réalité des décisions des utilisateurs

Trop souvent, la sensibilisation à la cybersécurité est pensée depuis le bureau du RSSI. Avec pour résultat : des messages techniques, généraux, peu engageants.C’est difficile de changer les comportements avec ce type d’approche.

Pour cela, il est nécessaire de changer de posture, et de passer d’une logique descendante, du RSSI vers l’utilisateur, à une logique d’abord centrée sur l’utilisateur, que le RSSI va remonter dans son approche.

Ce changement de posture est fondamental dans une approche comportementale, visant à mettre en place des nudges. Voici quelques étapes pour y parvenir :

• Commencez par observer les comportements réels. Quelles sont les erreurs fréquentes ? Dans quel contexte surviennent-elles ?

• Agissez sur l’environnement. Pouvez-vous modifier l’interface, le message, ou le timing d’un rappel pour aider au bon choix ?

• Testez. Il n’y a pas de solutions miracles. Ce qui peut marcher avec des personnes, peut ne pas du tout fonctionner dans un autre contexte. Pour savoir si votre nudge fonctionne, créez des groupes tests (avec nudge) et un groupe témoin (sans nudge), puis observez les comportements entre les deux groupes. C’est ce qui s’appelle un A/B testing. L’écart entre les deux groupes démontre le changement imputable au nudge.

Inviter chaque utilisateur à créer des nudges pour lui-même

Une seconde piste consiste à faire prendre conscience aux utilisateurs de leurs propres biais. Pour les aider à lutter contre eux-mêmes dans le but de respecter effectivement des règles qu’ils souhaitent le plus souvent respecter. Cela s’appelle de la métacognition : « La métacognition fait référence à la connaissance qu'on a de ses propres processus cognitifs et de leurs produits ou de ce qui leur est relié, par exemple, les propriétés différentes des informations ou des données pertinentes pour leur apprentissage » (Flavell, 1976). L’auteur précise par ailleurs que « la métacognition se rapporte, entre autres choses, au contrôle actif, à la régulation et à l'orchestration de ces processus en fonction des objets cognitifs et des données sur lesquelles ils portent, habituellement pour servir un objectif ou un but concret ». Selon cette acceptation, la métacognition est à la fois la connaissance de ses processus de décision, et la régulation de celui-ci (Noël et al., 1995).

En instruisant les utilisateurs sur leurs propres biais lors des formations à la cyber sécurité, il est possible de les inviter à réfléchir à ceux qui les influencent plus. Et de leur proposer d’y trouver eux-mêmes un remède, un nudge. Par exemple :

• Pour les utilisateurs qui aiment vider leur boite de réception en classant leurs emails, la création d’un dossier « Mails douteux » peut mettre en saillance la nécessité de réfléchir avant de cliquer sur des liens, et d’isoler le mail pour y revenir plus tard, en cas de doute.

• Systématiser l’utilisation d’un gestionnaire de mot de passe, pour en faire une utilisation par défaut, et migrer par étapes tous ses anciens comptes et mots de passe dans le gestionnaire. En évitant de vouloir les migrer tous en même temps, car cela demandera trop d’effort et invitera à la procrastination.

• S’envoyer des invitations Outlook pour réserver une plage de 15 minutes tous les 3 mois pour nettoyer votre Partage OneDrive, ou une invitation tous les vendredis à 16h, juste vous demandez combien de Cyber arnaques vous avez repérés dans la semaine ? Et vous en féliciter.

A chacun d’inventer le nudge qui lui conviendra le mieux dans son propre environnement.

En résumé

Les sciences comportementales nous rappellent une chose essentielle : nous ne sommes pas rationnels… mais nous sommes irrationnels de manière prévisible (Ariely 2008).

Plutôt que d’ignorer cette réalité, il est temps de l’embrasser.

En utilisant les nudges, en comprenant nos biais, et en créant des environnements qui favorisent naturellement les bons choix, les RSSI peuvent faire de la sensibilisation un levier puissant — et humain — de cybersécurité. Et les utilisateurs s’aider eux-mêmes à mieux respecter des règles qu’ils comprennent et avec lesquelles ils adhèrent Parfois, un petit coup de pouce discret est bien plus efficace qu’un grand discours de prévention.

👉Et si vous proposiez à vos collaborateurs une conférence originale qui leur explique tout cela ?

contactez moi : timoleon@jesensibilise.com

Commentaires